312

12-04-2016

2016 International Conference on Consumer Electronics-Berlin

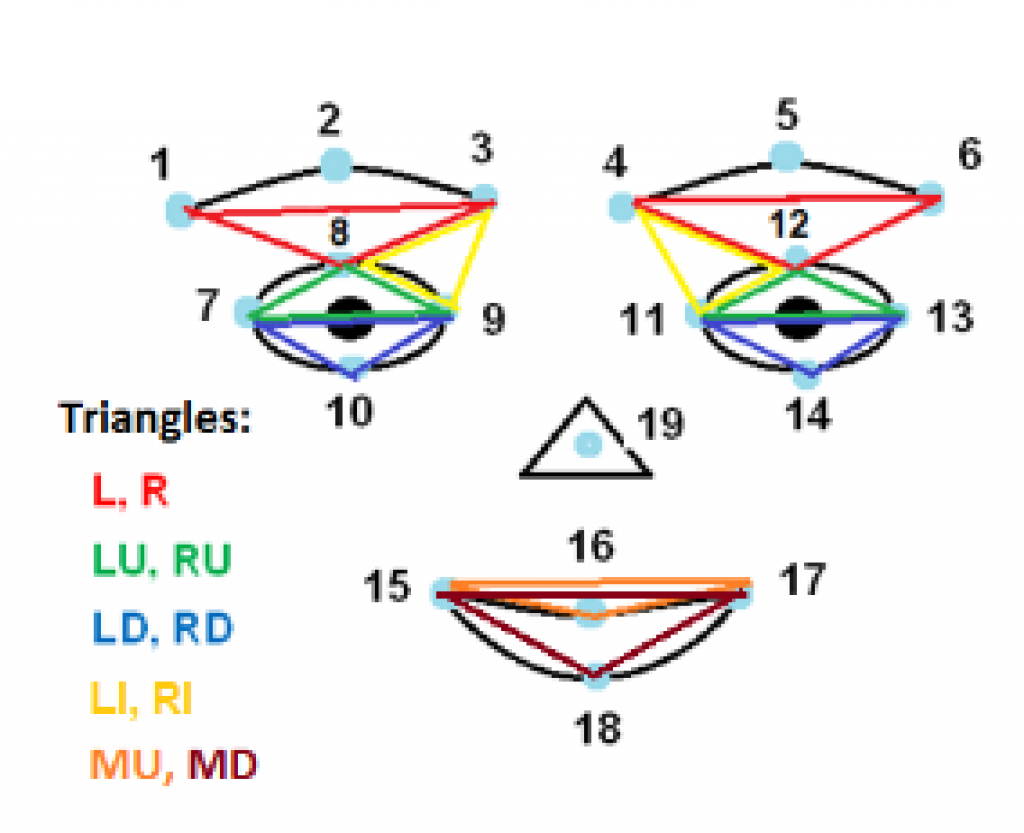

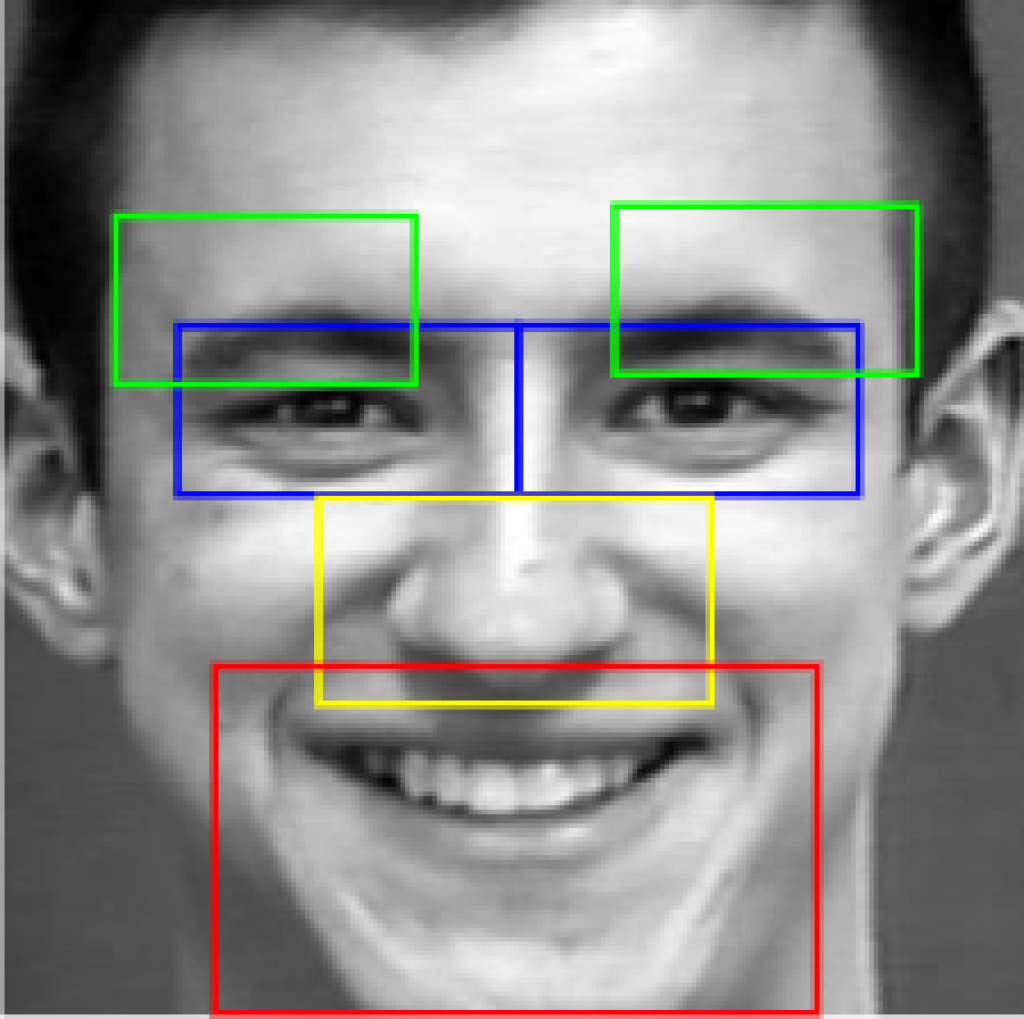

Este artículo presenta un algoritmo sencillo y rápido de reconocimiento de expresiones destinado a ejecutarse en un plano secundario para proporcionar conciencia de las emociones en aplicaciones primarias como, por ejemplo, los exergames, en tiempo real. El algoritmo se basa en la extracción de 19 puntos de referencia faciales que se utilizan para detectar algunas de las Unidades de Acción (UAs) definidas en el Sistema de Codificación de Acciones Faciales (FACS) y una de nueva creación. Además, se presenta el nuevo concepto de Unidades de Acción Combinadas (CAU). Se trata de UAs agrupadas que se detectan como una unidad. La clasificación de emociones aplicada se basa en reglas lógicas, no hay aprendizaje. Se han realizado las primeras implementaciones en una plataforma móvil.