109

17-07-2025

Integración de un módulo de detección de emociones en un middleware para juegos serios terapéuticos - Proyecto final de Máster Universitario oficial en Internet de las Cosas

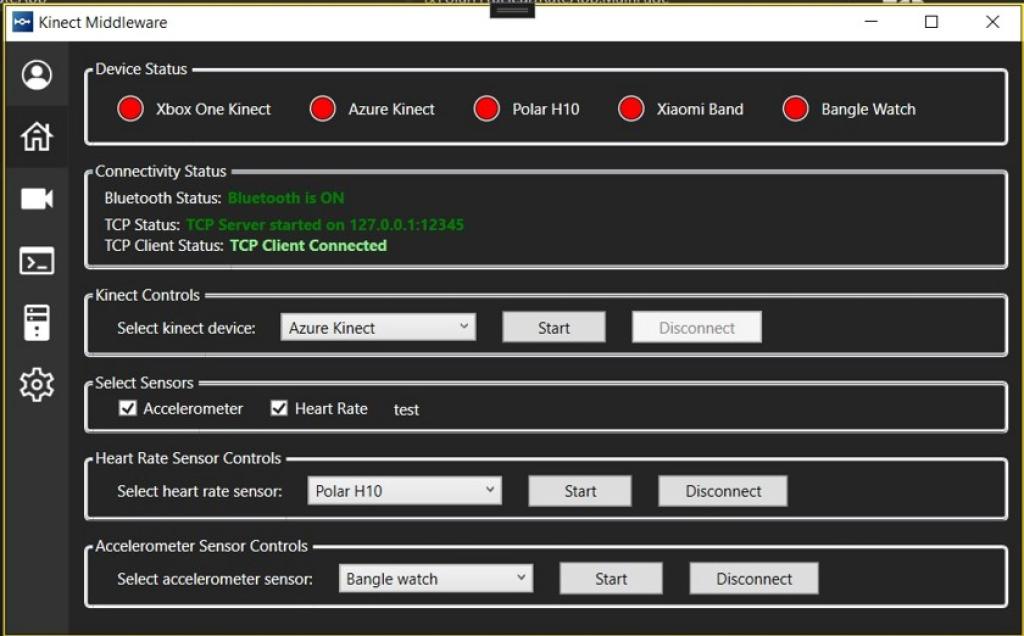

Esta tesis presenta el desarrollo e integración de un módulo de Reconocimiento de Emociones Faciales (FER) en Blexer Middleware, un componente de una plataforma de juegos terapéuticos diseñada para apoyar la rehabilitación motora. Aprovechando las capacidades de los sensores Kinect y los modelos de aprendizaje profundo, el sistema permite la detección en tiempo real de los estados emocionales de los jugadores durante el juego. El módulo FER funciona como un subsistema de borde del IoT, operando localmente en los dispositivos del paciente para realizar inferencias en el dispositivo y transmitir datos emocionales junto con información esquelética. El desarrollo siguió un proceso de dos fases: el entrenamiento de una red neuronal convolucional en el conjunto de datos FER-2013 y la integración del modelo en el middleware utilizando el formato ONNX para su compatibilidad con el marco .NET. Si bien la implementación actual se centra en la detección de emociones y la transmisión de datos en tiempo real, se prevé la compatibilidad con el ajuste dinámico de dificultad (DDA) basado en emociones como una mejora futura destinada a mejorar la participación y la eficacia terapéutica. El proyecto refuerza el papel de las arquitecturas de Internet de las cosas en aplicaciones orientadas a la salud al combinar la detección de emociones, el seguimiento esquelético y la retroalimentación adaptativa en un entorno modular y en tiempo real.